Como o Airbnb usou IAs para migrar 3.500 testes em seis semanas

Uso de prompts com até 100 mil tokens e ciclos de tentativa foram cruciais para migração. Mais: ferramenta para agentes de IA do Postman, Discord traz recursos sociais para jogos e a gestão do Linux.

O que levaria um time inteiro de desenvolvedores um ano e meio para completar manualmente foi resolvido em apenas seis semanas com ajuda de inteligência artificial. O Airbnb compartilhou sua experiência na migração de quase 3.500 arquivos de testes de componentes React, abandonando a ferramenta Enzyme em favor da React Testing Library (RTL).

A migração era necessária porque o Enzyme, usado desde 2015, foi projetado para versões anteriores do React e não estava alinhado com práticas modernas de teste. No entanto, as diferenças fundamentais entre as ferramentas tornavam impossível uma simples substituição, e apagar os testes antigos criaria lacunas significativas na cobertura de código.

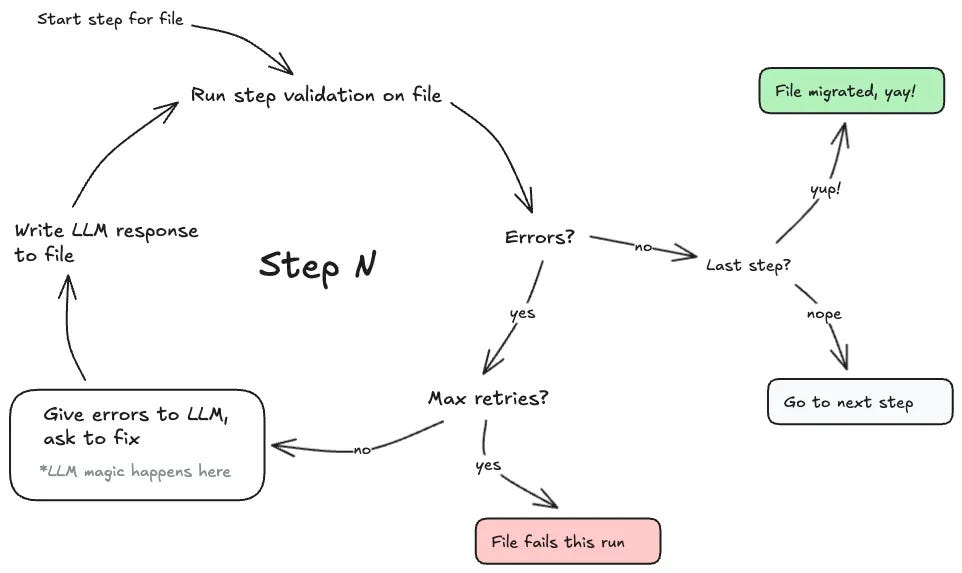

A equipe do Airbnb estruturou um pipeline de migração que tratava cada arquivo individualmente, processando-os em paralelo através de etapas discretas. O processo funcionava como uma máquina de estados: cada arquivo passava por validações, e quando uma verificação falhava, o sistema acionava um modelo de linguagem (LLM) para corrigir os problemas específicos.

"Encontramos a rota mais eficaz para melhorar os resultados: repetir etapas várias vezes até que passassem ou chegássemos a um limite", explicou Charles Covey-Brandt, autor do artigo. Esse ciclo de tentativas permitiu migrar arquivos de complexidade simples a média, com a maioria concluída em até 10 tentativas.

Para arquivos mais complexos, a equipe expandiu significativamente o contexto fornecido aos modelos de IA. Os prompts cresceram para até 100 mil tokens, incorporando até 50 arquivos relacionados, exemplos elaborados manualmente e testes existentes bem escritos do mesmo projeto.

Na primeira execução em massa, 75% dos arquivos foram migrados em apenas quatro horas. Para os 25% restantes, a equipe implementou um loop de feedback sistemático: executar arquivos com falha para identificar problemas comuns, selecionar amostras representativas, ajustar os prompts e scripts, validar as correções e repetir o processo.

Após quatro dias de ajustes, o índice de sucesso subiu para 97%. Os 3% restantes, que haviam sido tentados entre 50 e 100 vezes cada, foram finalizados manualmente na semana seguinte com base nas refatorações parciais geradas pelo sistema.

O mais importante foi que a migração manteve a intenção original dos testes e a cobertura de código, com custo total (incluindo uso de APIs de IA e seis semanas de trabalho de engenharia) muito menor que a estimativa original de migração manual.

Vale a leitura do artigo completo no blog do Airbnb Engineering para entender como a empresa organizou esse processo em detalhes. A abordagem representa um caso prático de uso empresarial de LLMs e pode servir de inspiração para outras empresas com desafios semelhantes de refatoração em larga escala.

Manus: agente de IA chinês surpreende com autonomia e colaboração

Manus ("mãos", em latim), novo agente de IA generalista da startup chinesa Butterfly Effect, ganhou atenção global desde seu lançamento na semana passada. Diferente dos chatbots convencionais, utiliza múltiplos modelos de IA para atuar de forma autônoma em diversas tarefas. Em testes realizados pela MIT Technology Review, mostrou-se eficiente e colaborativo, apesar de instabilidades técnicas. A ferramenta se destaca pela transparência do processo de trabalho e pelo custo — cerca de US$ 2 por tarefa, um décimo do cobrado pelo ChatGPT DeepResearch. O acesso ainda é limitado, com menos de 1% dos usuários na lista de espera recebendo códigos de convite. Vale dar uma olhada em Manus.im.

Postman lança ferramenta para construção de agentes de IA

Na mesma linha, o Postman anunciou o AI Agent Builder, nova plataforma para desenvolvedores criarem agentes de IA sem necessidade de codificação extensa. A ferramenta permite transformar APIs em componentes compatíveis com agentes através de um canvas visual, onde é possível interligar serviços como Slack, OpenAI, Notion etc. em fluxos de trabalho multiestágio. Entre os casos disponíveis estão atendimento ao cliente automatizado e gerenciamento de incidentes. A plataforma também oferece comparação de desempenho entre diferentes LLMs para auxiliar na escolha do modelo mais adequado. Mais aqui, aqui e aqui.

Discord Social SDK: integração social direta nos jogos

O Discord lançou um SDK para desenvolvedores integrarem recursos sociais nos jogos sem exigir que usuários tenham conta na plataforma. A biblioteca C++ oferece lista de amigos, mensagens, comunicação por voz e lobbies diretamente no jogo. Com "contas provisórias" para não-usuários, o sistema unifica a experiência social para todos os jogadores. Disponível para Unity e Unreal, o SDK fornece apenas dados, deixando aos desenvolvedores a criação da interface. Mais aqui e aqui.

MCP padroniza acesso a dados por modelos de IA

O Model Context Protocol da Anthropic está ganhando adoção como padrão para conectar IAs a dados externos. Semelhante ao USB-C para dispositivos físicos, o MCP permite que qualquer modelo acesse diversas fontes de dados através de uma interface única. Desenvolvedores já criaram mais de mil servidores MCP para integração com serviços como Google Drive, GitHub e bancos de dados. A especificação ainda está em evolução, com desafios em ambientes de produção, mas promete simplificar o desenvolvimento de aplicações de IA mais conectadas ao mundo real. Mais aqui, aqui e aqui.

Linux: como é construído o sistema operacional mais usado do mundo

O Linux, presente em 4 bilhões de dispositivos Android e inúmeros servidores, segue um modelo de desenvolvimento único – e que vai contra muito do que se prega em gestão de projetos. Greg Kroah-Hartman, mantenedor do kernel há 25 anos, revela que o sistema opera em ciclos rígidos de 9 semanas, com hierarquia clara: 4.000 devs enviam mudanças para mantenedores de subsistemas antes de chegarem ao criador Linus Torvalds. Sem reuniões ou gerentes de projeto, o processo funciona apenas com e-mail e git porque os colaboradores já trazem trabalho concluído e porque o modelo é baseado em confiança. Mais aqui.

Obrigado por acompanhar a BeTalent Academy. Se gostou, compartilhe e deixe um comentário. Até a próxima semana, com mais uma edição!