Agentes de IA: dicas para implementação prática

Tem desde guia extenso até código passo a passo para aprender sobre agentes. Mais: recursos JS para dominar em 2025, GPT 4.1 com melhorias em programação e Google se comunicando com golfinhos por IA.

A construção de agentes inteligentes tornou-se um dos temas mais discutidos no desenvolvimento de software, mas um fato importante emerge dos textos técnicos recentes: criar agentes de IA funcionais é menos complexo do que muitos desenvolvedores presumem.

A essência de um agente de IA está em sua capacidade de autonomia. Conforme define um guia extenso da OpenAI, um agente é um sistema que realiza tarefas em nome do usuário com alto grau de independência. Diferente de aplicações simples que integram LLMs – como chatbots ou classificadores de sentimento – os agentes gerenciam fluxos de trabalho completos.

Em seu artigo "How to Build an Agent", Thorsten Ball demonstra que a construção básica de um agente pode ser realizada com menos de 400 linhas de código. O exemplo apresentado por ele utiliza três componentes: um modelo de linguagem, um loop e tokens suficientes, complementados por ferramentas simples para leitura de arquivos, listagem de diretórios e edição de código.

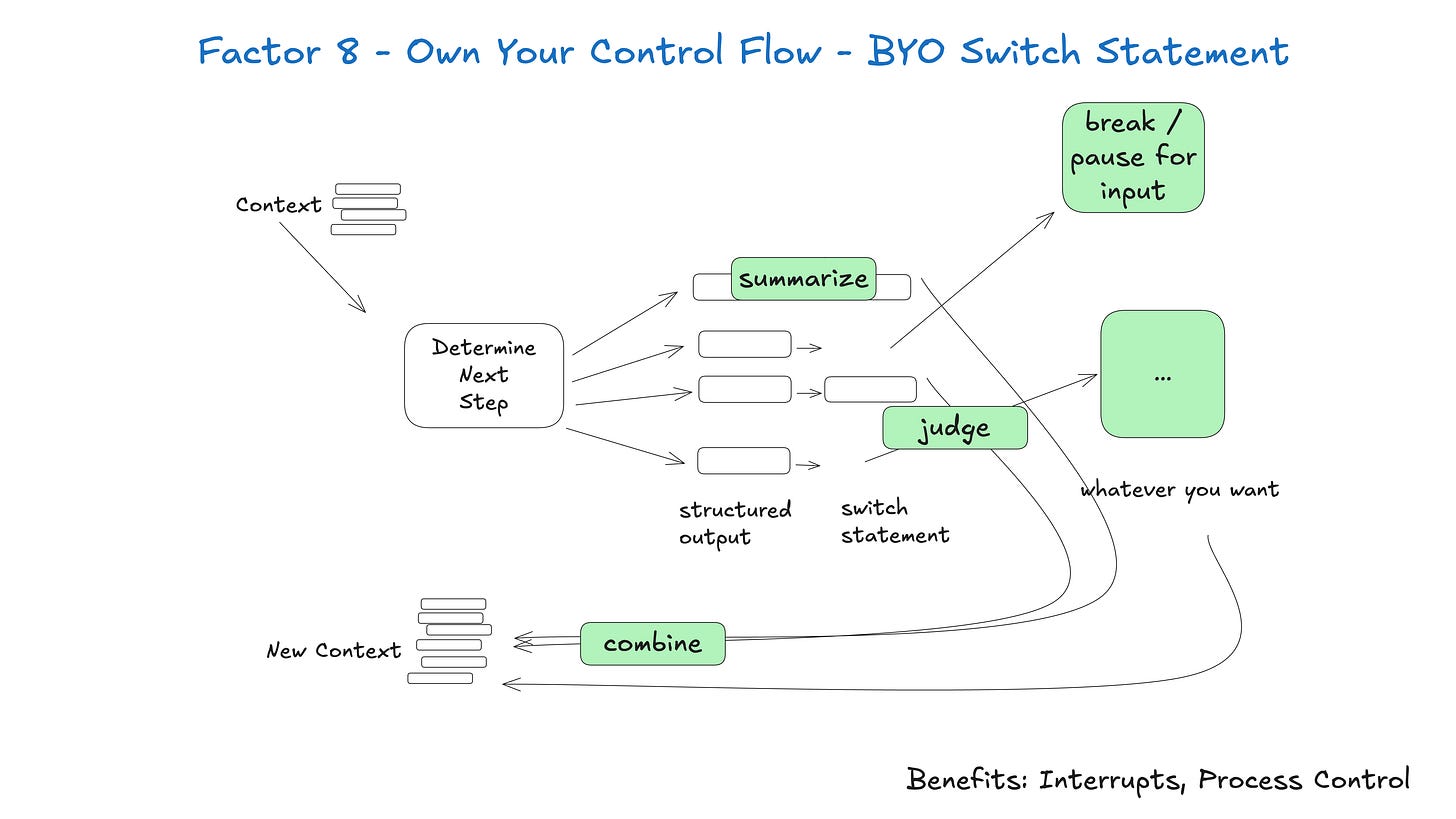

No projeto "12 Factor Agents", Dex Horthy compartilha conclusões semelhantes após analisar diversos frameworks de agentes. Ele observa que, após conversar com fundadores que construíram sistemas impressionantes com IA, descobriu que a maioria dos produtos comercialmente viáveis não segue o padrão "aqui está seu prompt, aqui estão suas ferramentas, execute até atingir o objetivo". Na realidade, os melhores agentes são compostos principalmente por software convencional, com etapas de LLM estrategicamente posicionadas.

A estrutura fundamental de um agente eficiente inclui três elementos principais: o modelo de linguagem que impulsiona o raciocínio e a tomada de decisão, as ferramentas externas que permitem interações com sistemas, e instruções claras que definem comportamentos e limites. O ciclo operacional segue uma lógica direta: o modelo determina a próxima ação, o código executa a ferramenta correspondente, e o resultado alimenta o contexto para decisões subsequentes.

Com o aumento da complexidade, padrões de orquestração tornam-se necessários. O guia da OpenAI descreve dois principais: o padrão "Manager", onde um agente central coordena agentes especializados via chamadas de ferramentas, e o modelo descentralizado, em que múltiplos agentes transferem o controle entre si conforme necessário.

Para implementações iniciais, tanto a OpenAI quanto o projeto 12-Factor recomendam maximizar primeiro as capacidades de um único agente antes de construir sistemas multi-agentes. Os casos de uso mais adequados são aqueles que resistiram à automação convencional: fluxos envolvendo decisões contextuais complexas, sistemas com regras difíceis de manter ou processos dependentes de dados não estruturados.

O valor dos agentes está em sua capacidade de unir o raciocínio dos LLMs com ações concretas em sistemas externos. As ferramentas e técnicas para implementação já estão disponíveis, permitindo a transformação de tarefas complexas em processos automatizados com maior autonomia e capacidade de adaptação.

Para saber mais, vale a leitura de "How to Build an Agent", que traz código para quem quer pôr a mão na massa, e "12 Factor Agents", com os 12 fatores extensamente detalhados. Já "A Practical Guide to Building Agents", da OpenAI, é um guia abrangente em PDF sobre como projetar, implementar e garantir a segurança de agentes de IA, com foco em fundamentos de design, orquestração e guardrails práticos. Uma boa pedida para estudar neste feriadão.

Recursos JS que todo dev deveria conhecer em 2025

JavaScript evolui constantemente com novos recursos que otimizam o código. Em 2025, destacam-se os Iterator Helpers, que evitam arrays temporários em transformações encadeadas, o Promise.withResolvers() que simplifica códigos verbosos, e o método at() para arrays com indexação negativa. Outras adições importantes são as operações booleanas para Sets, o structuredClone() para cópias profundas de objetos e os Tagged Templates para manipulação avançada de strings. Mais neste artigo.

OpenAI lança família GPT-4.1 com avanços em programação

OpenAI anunciou três novos modelos para sua API: GPT-4.1, GPT-4.1 mini e GPT-4.1 nano. O modelo principal supera o GPT-4o em várias métricas, com destaque para programação, onde obteve 54,6% no benchmark SWE-bench Verified — 21,4% a mais que seu antecessor. A nova família também apresenta maior janela de contexto (1 milhão de tokens), melhor compreensão de instruções complexas e preços reduzidos. O GPT-4.1 mini chega a superar o GPT-4o em alguns benchmarks, enquanto o nano se posiciona como o modelo mais rápido e econômico da empresa. Mais no anúncio oficial.

Cases mostram como otimizar React em larga escala

O site largeapps.dev divulga um livro sobre uso de React em larga escala. Um gostinho do que está no conteúdo pode ser conferido no artigo "Advanced React in the Wild". Ele traz casos como o da DoorDash, que migrou de CSR para SSR e reduziu o tempo de carregamento em 65%, e o da Preply, que diminuiu a latência de 1,5s para 0,5s com estratégias de cache. O artigo destaca uso de React Server Components, streaming SSR e gerenciamento de estado mais leve, preferindo Context API a soluções monolíticas. Mais no artigo completo.

Já testou a geração de imagens do GPT-4o?

Se ainda não, deveria. Se sim, provavelmente se surpreendeu. Diferente de modelos anteriores focados em cenas "surreais", o sistema foi projetado para criar imagens mais úteis e assertivas. A ferramenta se destaca na renderização mais precisa de textos, diagramas, logos e símbolos. O modelo aproveita a distribuição conjunta de imagens e textos online, resultando em fluência visual capaz de gerar conteúdo mais útil que o DALL-E, modelo usado anteriormente e que normalmente gerava imagens clichês. Mais no anúncio oficial e no ChatGPT pago.

Google usa IA e Pixel para se comunicar com golfinhos

DolphinGemma é um modelo de IA do Google capaz de analisar sons de golfinhos através de smartphones Pixel. A tecnologia identifica padrões em assobios e estalos e tem auxiliado pesquisadores da Wild Dolphin Project a compreender comportamentos desses mamíferos marinhos após 40 anos de estudos. O sistema deve ser disponibilizado como modelo aberto para que cientistas de todo o mundo avancem em estudos da comunicação “delfínica”. Mais no Google Blog.

Obrigado por acompanhar a BeTalent Academy. Se gostou, compartilhe e deixe um comentário. Até a próxima semana, com mais uma edição!